OpenAI Introduce la Modalità Vocale Avanzata per ChatGPT

OpenAI ha annunciato il lancio della Modalità Vocale Avanzata (AVM), disponibile per un numero maggiore di clienti paganti di ChatGPT a partire da martedì. Questa nuova funzionalità audio rende l'interazione con ChatGPT più naturale e sarà inizialmente accessibile agli utenti dei piani Plus e Teams. I clienti delle categorie Enterprise ed Edu inizieranno a ricevere l'accesso dalla prossima settimana.

Design Rivisitato della Modalità Vocale

Con il lancio di AVM, è stato introdotto un design rinnovato. La funzionalità è ora rappresentata da una sfera blu animata, sostituendo i precedenti punti neri animati mostrati da OpenAI durante la presentazione della tecnologia a maggio.

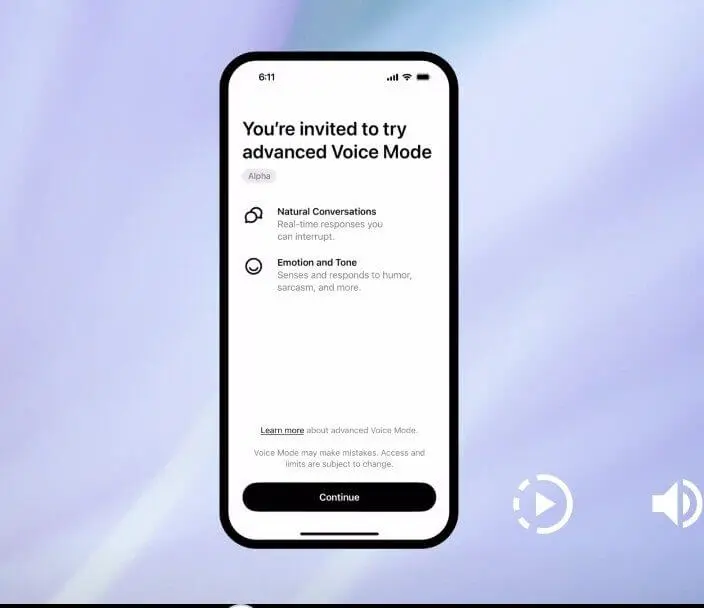

Gli utenti riceveranno una notifica pop-up nell'app di ChatGPT, accanto all'icona vocale, quando AVM sarà disponibile per loro.

Nuove Funzionalità e Voci

La Modalità Vocale Avanzata sarà implementata per tutti gli utenti Plus e Team nell'app di ChatGPT nel corso della settimana. Nel frattempo, OpenAI ha aggiunto anche Istruzioni Personalizzate, Memoria, cinque nuove voci e accenti migliorati. Inoltre, ChatGPT è in grado di dire “Scusa, sono in ritardo” in oltre 50 lingue.

Le Nuove Voci di ChatGPT

Le cinque nuove voci disponibili per gli utenti sono: Arbor, Maple, Sol, Spruce e Vale. Con queste aggiunte, il numero totale di voci di ChatGPT arriva a nove, quasi quanto quelle di Gemini Live di Google. Tutti i nomi delle voci sono ispirati alla natura, sottolineando l'intento di rendere l'interazione con ChatGPT più fluida e naturale.

Assenza di Alcune Funzionalità

Tuttavia, una voce assente da questo elenco è Sky, presentata da OpenAI durante l'aggiornamento primaverile, che ha portato a una minaccia legale da parte di Scarlett Johansson. L'attrice, che ha interpretato un sistema AI nel film “Her”, ha affermato che la voce di Sky somigliava troppo alla sua. OpenAI ha prontamente rimosso la voce, dichiarando di non aver mai avuto l'intenzione di imitare quella di Johansson, nonostante alcuni membri dello staff avessero fatto riferimenti al film sui social.

Un'altra funzionalità non inclusa nel lancio è la condivisione di video e schermo, presentata da OpenAI durante l'aggiornamento primaverile di quattro mesi fa. Questa funzione dovrebbe consentire a GPT-4o di elaborare simultaneamente informazioni visive e uditive. Durante la demo, un membro dello staff di OpenAI ha mostrato come fosse possibile porre domande in tempo reale a ChatGPT riguardo a problemi matematici su un foglio di carta o codice sullo schermo del computer. Attualmente, OpenAI non ha fornito un piano temporale per il lancio di queste capacità multimodali.

Miglioramenti e Personalizzazione

OpenAI ha dichiarato di aver apportato miglioramenti alla funzionalità vocale di ChatGPT da quando ha rilasciato il test alpha limitato di AVM. La nuova modalità è presumibilmente più efficace nel comprendere gli accenti, e l'azienda afferma che le conversazioni sono ora più fluide e veloci. Durante i test con AVM, sono stati riscontrati alcuni malfunzionamenti, ma l'azienda sostiene che questi siano stati migliorati.

Inoltre, OpenAI sta espandendo alcune delle funzionalità di personalizzazione di ChatGPT a AVM: le Istruzioni Personalizzate, che consentono agli utenti di personalizzare le risposte di ChatGPT, e la Memoria, che permette a ChatGPT di ricordare le conversazioni per un riferimento futuro.

Un portavoce di OpenAI ha comunicato che AVM non è ancora disponibile in diverse regioni, tra cui UE, Regno Unito, Svizzera, Islanda, Norvegia e Liechtenstein.